Yapay Zeka Dünyasında Güvenlik ve Suçla Mücadele

Yapay zeka teknolojileri, hayatın her alanına nüfuz ederek modern dünyanın işleyişini kökten değiştiriyor. Günümüzde son kullanıcılar, ChatGPT, Gemini, DeepSeek, Perplexity, Grok, Microsoft Copilot ve Claude gibi büyük dil modelleri aracılığıyla bu teknolojiden her geçen gün daha fazla yararlanıyor. Araştırmadan sağlığa, kod yazımından sanatsal üretime kadar geniş bir yelpazede kullanılan bu modeller, sundukları devasa bilgi birikimiyle insanlığa hizmet ediyor. Ancak bu güçlü teknoloji, madalyonun diğer yüzünde bazı kullanıcılar tarafından suç amaçlı faaliyetlerin planlanması veya icra edilmesi için de bir araç haline getirilebiliyor.

Dijital Denetim ve Otomatik Tespit Mekanizmaları

Yapay zeka platformları, sistemlerinin kötüye kullanımını engellemek amacıyla gelişmiş güvenlik protokolleri uyguluyor. Modeller, fiziksel saldırıların planlanması, silah ve mühimmat üretimi gibi tehlikeli talepleri tespit etmek üzere sürekli bir eğitim sürecinden geçiriliyor. Bir kullanıcı, etik sınırları ve yasal çerçeveleri aşan bir istemde bulunduğunda, yapay zeka algoritmaları bu durumu anlık olarak analiz ediyor. Şüpheli görülen içerikler işaretlenerek insan denetçilere aktarılıyor, kullanıcının hesabı kalıcı olarak kapatılabiliyor ve gerekli görüldüğü durumlarda güvenlik birimlerine kritik bilgiler iletilebiliyor.

Kanada’daki Trajik Olay ve OpenAI’ın Müdahalesi

Yapay zekanın suç amaçlı kullanımına dair en somut ve trajik örneklerden biri Kanada’da yaşandı. British Columbia eyaletinde, 10 Şubat tarihinde bir okul ve bir evde düzenlenen silahlı saldırı sonucunda, saldırganın da dahil olduğu 10 kişi hayatını kaybederken, 27 kişi yaralandı. Saldırganın 18 yaşındaki Jesse Van Rootselaar olduğu açıklanırken, olayın ardından dikkat çekici bir detay ortaya çıktı: OpenAI tarafından geliştirilen ChatGPT, bu saldırganın tehlikeli niyetlerini aylar öncesinden tespit etmişti.

Veri Analizi ve Erken Uyarı Sistemleri

Wall Street Journal tarafından aktarılan bilgilere göre, Jesse Van Rootselaar geçen yılın Haziran ayında, birkaç gün boyunca ChatGPT ile silahlı şiddet içeren çeşitli senaryolar üzerine yazışmalar gerçekleştirdi. Bu diyaloglar, platformun otomatik inceleme sistemi tarafından “yüksek riskli” olarak işaretlendi. OpenAI çalışanlarının yaptığı detaylı inceleme sonucunda, kullanıcının niyetinin suç teşkil edebileceği öngörüldü ve kullanıcının hesabı derhal kapatıldı. Bu durum, yapay zekanın sadece bir bilgi kaynağı değil, aynı zamanda potansiyel tehditleri önceden sezen bir erken uyarı mekanizması olarak çalıştığını kanıtladı.

Etik İkilem: Önleyici Tedbir mi, Veri Mahremiyeti mi?

Bu tür olaylar, teknoloji dünyasında çok kritik bir tartışmayı da beraberinde getiriyor: Önleyici tedbir mi, yoksa veri mahremiyeti mi? Bir yanda bireylerin özel yazışmalarının gizliliği savunulurken, diğer yanda toplumsal güvenliği sağlamak adına bu verilerin denetlenmesi zorunluluğu yer alıyor. Yapay zeka platformları, bu dengeyi korumak için modellerini “etik sınırlar” dahilinde tutmaya çalışsa da, suçluların filtreleri aşmak için geliştirdiği yöntemler, güvenlik ekiplerini sürekli bir savunma yarışı içinde tutuyor. Kanada örneği, dijital ayak izlerinin takip edilmesinin, fiziksel dünyadaki felaketleri önlemede ne kadar hayati olabileceğini bir kez daha gözler önüne seriyor.

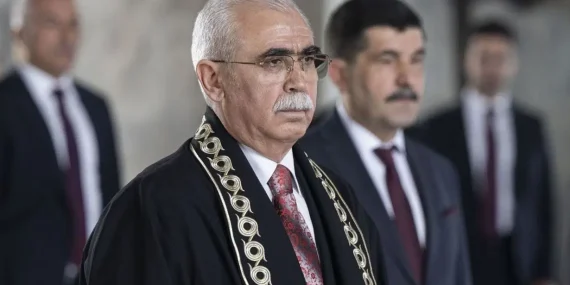

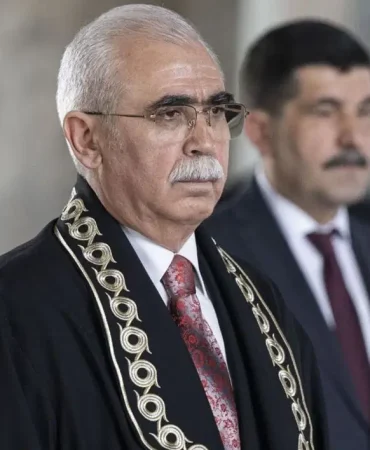

Dipnot: Ana görselde yer alan yapay zekanın tespit ettiği,10 Şubat 2026’da Tumbler Ridge’de meydana gelen toplu silahlı saldırının şüphelisi 18 yaşındaki Jesse Van Rootselaar, tarih belirtilmemiş bir fotoğrafta görülüyor. (BC RCMP/dağıtım)